Nvidia Instant NeRF AI renderuje sceny 3D ze zdjęć 2D w kilka sekund

W kontekście: Nvidia bawi się NeRFami. Nie, nie strzelali do siebie piankowymi strzałkami. Termin NeRF jest skrótem od Neural Radiance Field. Jest to technika wykorzystująca sztuczną inteligencję do tworzenia trójwymiarowej sceny z kilku nieruchomych obrazów (renderowanie odwrotne). W zależności od wymaganej głębokości renderowanie wyników zajmuje zwykle godziny lub dni.

Dział badań AI Nvidii pracował nad renderowaniem odwrotnym i opracował Neural Radiance Field, które nazywa Instant NeRF, ponieważ może renderować scenę 3D nawet 1000 razy szybciej niż inne techniki NeRF. Model sztucznej inteligencji potrzebuje tylko kilku sekund, aby przeszkolić kilkadziesiąt kadrów wykonanych pod różnymi kątami, a następnie zaledwie kilkadziesiąt milisekund więcej, aby wyrenderować widok 3D sceny.

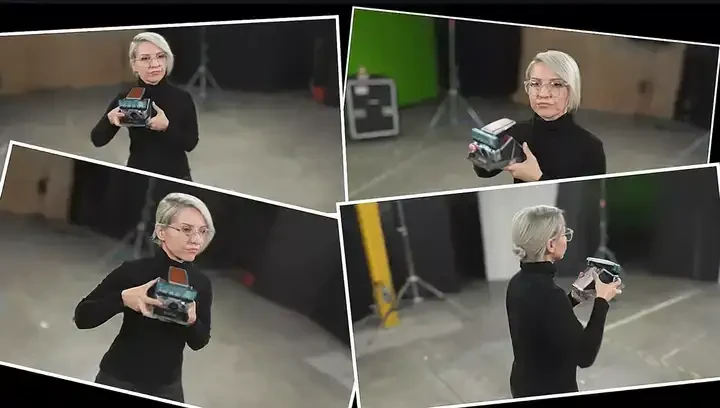

Ponieważ proces ten jest przeciwieństwem robienia polaroidu — to znaczy natychmiastowego przekształcania sceny 3D w obraz 2D — Nvidia odtworzyła zdjęcie Andy’ego Warhola za pomocą polaroidu. W tym tygodniu zespół badawczy zaprezentował demo wyników Instant NeRF na Nvidia GTC (poniżej).

„Instant NeRF może być używany do tworzenia awatarów lub scen do wirtualnych światów, rejestrowania uczestników wideokonferencji i ich otoczenia w 3D lub do rekonstrukcji scen na cyfrowe mapy 3D" – powiedziała Nvidia. „Zbieranie danych w celu zasilenia NeRF jest trochę jak bycie fotografem z czerwonego dywanu, próbującym uchwycić strój celebryty pod każdym kątem — sieć neuronowa wymaga kilkudziesięciu zdjęć zrobionych z różnych miejsc wokół sceny, a także pozycji kamery każdego z nich tych strzałów”.

NeRF generuje obraz 3D z tych dziesiątek kątów, wypełniając luki w razie potrzeby. Może nawet kompensować okluzje. Na przykład, jeśli obiekt blokuje widok obiektu na jednym z obrazów, sztuczna inteligencja może nadal wypełniać ten kąt, nawet jeśli nie widzi dobrze obiektu lub wcale.

Jedynym obszarem słabości tej technologii jest radzenie sobie z poruszającymi się obiektami.

„W scenie, która zawiera ludzi lub inne ruchome elementy, im szybciej te ujęcia zostaną zrobione, tym lepiej” – powiedziała Nvidia. „Jeśli podczas procesu przechwytywania obrazu 2D jest zbyt dużo ruchu, scena 3D wygenerowana przez sztuczną inteligencję będzie rozmyta”.

Aby uzyskać więcej szczegółów technicznych, sprawdź wpis na blogu Nvidii. Możesz także obejrzeć resztę przemówienia Jensena Huanga dotyczącego GTC na YouTube.

Comments are closed, but trackbacks and pingbacks are open.