Nvidias Instant NeRF AI rendert 3D-Szenen aus 2D-Fotos in nur wenigen Sekunden

Im Kontext: Nvidia hat mit NeRFs gespielt. Nein, sie haben sich nicht mit Schaumpfeilen beschossen. Der Begriff NeRF ist die Abkürzung für Neural Radiance Field. Es ist eine Technik, die KI verwendet, um aus einer Handvoll Standbildern eine dreidimensionale Szene zu erstellen (inverses Rendering). Je nachdem, wie viel Tiefe gewünscht wird, dauert es im Allgemeinen Stunden oder Tage, um Ergebnisse zu liefern.

Nvidias KI-Forschungsabteilung hat an inversem Rendering gearbeitet und ein neurales Strahlungsfeld entwickelt, das es Instant NeRF nennt, weil es die 3D-Szene bis zu 1.000-mal schneller rendern kann als andere NeRF- Techniken. Das KI-Modell benötigt nur wenige Sekunden, um mit ein paar Dutzend Standbildern zu trainieren, die aus verschiedenen Winkeln aufgenommen wurden, und dann nur noch zehn Millisekunden, um eine 3D-Ansicht der Szene zu rendern.

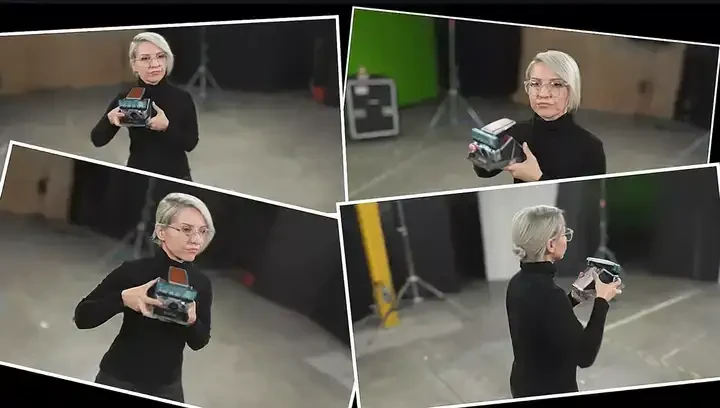

Da der Prozess das Gegenteil einer Polaroidaufnahme ist – das heißt, eine 3D-Szene sofort in ein 2D-Bild umwandelt – hat Nvidia ein Foto von Andy Warhol mit einem Polaroid nachgebildet. Diese Woche präsentierte das Forschungsteam eine Demo der Instant NeRF-Ergebnisse bei Nvidia GTC (unten).

„Instant NeRF könnte verwendet werden, um Avatare oder Szenen für virtuelle Welten zu erstellen, Videokonferenzteilnehmer und ihre Umgebung in 3D zu erfassen oder Szenen für digitale 3D-Karten zu rekonstruieren”, sagte Nvidia. „Das Sammeln von Daten, um ein NeRF zu füttern, ist ein bisschen so, als wäre man ein Fotograf auf dem roten Teppich, der versucht, das Outfit eines Prominenten aus jedem Blickwinkel einzufangen – das neuronale Netzwerk benötigt ein paar Dutzend Bilder, die von mehreren Positionen rund um die Szene aufgenommen wurden, sowie die Kameraposition von jedem dieser Schüsse."

Das NeRF generiert das 3D-Bild aus diesen Dutzenden von Winkeln und füllt die Lücken bei Bedarf aus. Es kann sogar Okklusionen ausgleichen. Wenn beispielsweise ein Objekt die Sicht auf das Motiv in einem der Bilder blockiert, kann die KI diesen Winkel immer noch ausfüllen, obwohl sie das Motiv nicht gut oder überhaupt nicht sehen kann.

Ein Schwachpunkt der Technologie ist der Umgang mit sich bewegenden Objekten.

„In einer Szene, die Menschen oder andere sich bewegende Elemente enthält, ist es umso besser, je schneller diese Aufnahmen gemacht werden”, sagte Nvidia. „Wenn es während der 2D-Bildaufnahme zu viel Bewegung gibt, wird die KI-generierte 3D-Szene verschwommen.”

Weitere technische Details finden Sie im Blogbeitrag von Nvidia. Den Rest der GTC-Keynote von Jensen Huang können Sie sich auch auf YouTube ansehen.