Nvidias Instant NeRF AI renderar 3D-scener från 2D-foton på bara några sekunder

I sammanhanget: Nvidia har lekt med NeRFs. Nej, de har inte skjutit varandra med skumpilar. Termen NeRF är en förkortning av Neural Radiance Field. Det är en teknik som använder AI för att skapa en tredimensionell scen från en handfull stillbilder (omvänd rendering). Beroende på hur mycket djup som önskas tar det vanligtvis timmar eller dagar att återge resultat.

Nvidias AI-forskningsarm har arbetat med omvänd rendering och utvecklat ett Neural Radiance Field som det kallar Instant NeRF eftersom det kan rendera 3D-scenen upp till 1 000 gånger snabbare än andra NeRF- tekniker. AI-modellen behöver bara några sekunder för att träna på några dussin stillbilder tagna från flera vinklar och sedan bara tiotals millisekunder till för att återge en 3D-vy av scenen.

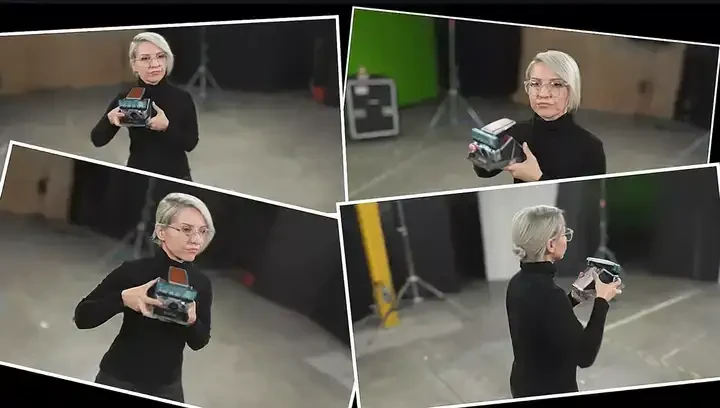

Eftersom processen är motsatsen till att ta en Polaroid – det vill säga att omedelbart förvandla en 3D-scen till en 2D-bild – återskapade Nvidia ett foto av Andy Warhol med en Polaroid. Den här veckan presenterade forskargruppen en demo av Instant NeRF-resultaten på Nvidia GTC (nedan).

"Instant NeRF kan användas för att skapa avatarer eller scener för virtuella världar, för att fånga videokonferensdeltagare och deras miljöer i 3D, eller för att rekonstruera scener för 3D digitala kartor", säger Nvidia. "Att samla in data för att mata en NeRF är lite som att vara en fotograf på röda mattan som försöker fånga en kändis outfit från alla vinklar – det neurala nätverket kräver några dussin bilder tagna från flera positioner runt scenen, såväl som kamerapositionen för varje av dessa skott."

NeRF genererar 3D-bilden från dessa dussintals vinklar och fyller i tomrummen där det behövs. Det kan till och med kompensera för ocklusioner. Till exempel, om ett objekt blockerar sikten på motivet i en av bilderna, kan AI:n fortfarande fylla i den vinkeln även om den inte kan se motivet bra eller alls.

Teknikens ena svaghetsområde är att hantera rörliga föremål.

"I en scen som inkluderar människor eller andra rörliga element, ju snabbare dessa bilder tas, desto bättre," sa Nvidia. "Om det blir för mycket rörelse under 2D-bildtagningsprocessen kommer den AI-genererade 3D-scenen att bli suddig."

För mer teknisk information, kolla in Nvidias blogginlägg. Du kan också fånga resten av Jensen Huangs GTC keynote på YouTube.